最近刷短视频,是不是经常看到那种“AI做的动画”?人物开口说话像被附体,走路像踩着滑板,眼神空洞却强行微笑……明明技术号称“智能”,观感却让人后背发凉。

这不是你审美有问题,而是当前AI生成动画确实还没跨过那道“自然感”的门槛。

要理解“怪”从何来,得先拆解动画的本质:动画不是画得多,而是动得对。人类对生物运动极其敏感——哪怕一个眨眼慢了0.1秒,大脑都会觉得“不对劲”。而AI目前最缺的,恰恰是对“真实运动逻辑”的深层建模。

一、动作:AI在“模仿”,而非“理解”

大多数AI动画依赖动作捕捉数据或预设模板。比如让角色挥手,模型只是从数据库里挑一个“挥手.gif”套上去。问题在于:真实人类挥手会带动肩膀、重心微移、头发飘动,甚至呼吸节奏都会变化。而AI往往只处理局部关节,忽略全身动力学,结果就是“上半身在演戏,下半身在发呆”。

更致命的是缺乏物理常识。AI不知道重力存在,所以角色坐下时可能直接“吸附”到椅子上;转身时头转了,身体还停在原地——这种违反直觉的断裂感,正是“恐怖谷效应”的温床。

二、表情与语音:两张皮

高质量动画讲究“声情并茂”。但目前主流流程是:先用TTS(文本转语音)生成配音,再用另一个模型驱动口型。两个模块各干各的,情绪完全脱节。

比如台词是“我太难过了”,AI配音可能语气平淡,而角色脸上却挂着程式化的“悲伤表情包”——眼眶泛红、嘴角下拉,但眼神毫无焦点。观众瞬间出戏:“这人到底难过啥?”

三、一致性崩坏:同一角色,十张脸

你有没有发现,有些AI动画里,主角换个镜头就“换人”了?鼻子变高、发型突变、衣服颜色跳帧……这是因为多数生成模型以单帧为单位工作,缺乏角色身份锚定机制。它不认为“这是同一个角色”,只觉得“这是一张新图”。

相比之下,传统动画师会建立角色设定表(model sheet),确保360度视角统一。而AI?它连“自己是谁”都还没搞清楚。

那么,普通用户就只能忍受这些“电子木偶”了吗?其实未必。

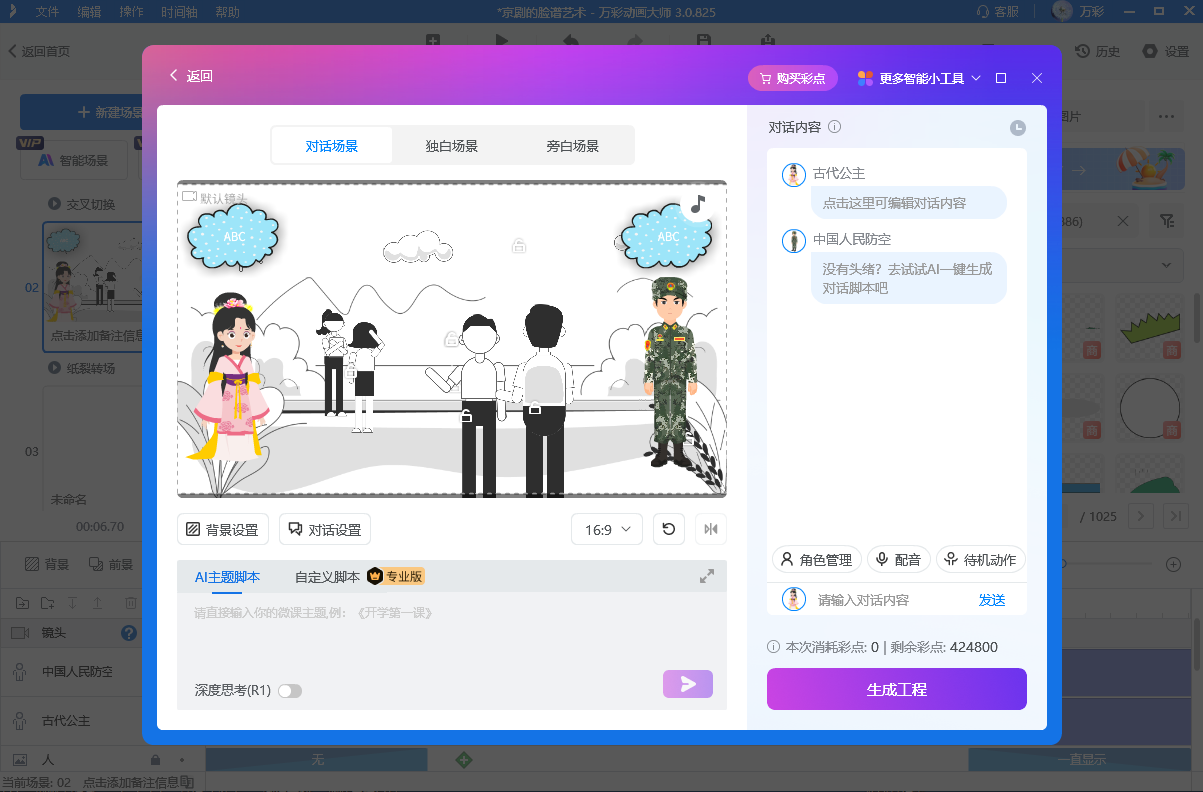

如果你不是要做电影级作品,而是做知识科普、企业宣传或教学视频,万彩动画大师是个务实的选择。它虽非纯端到端AI生成,但整合了AI智能成片和AI配音功能:输入脚本,自动匹配场景、角色动作、镜头切换,并优化口型同步与表情自然度。关键在于——它避开了当前AI动画最“翻车”的部分,用规则+AI混合的方式,在效率与观感之间找到了平衡点。

说到底,AI生成动画的“怪”,反映的是算法对人类行为理解的浅薄。我们离“AI斯皮尔伯格”还有很远,但在工具层面,已经可以聪明地绕过坑了。

毕竟,好动画不在于多“智能”,而在于多“可信”。

万彩动画大师官方下载地址:https://www.animiz.cn/